Предупреждение: эта страница является автоматическим (машинным) переводом, в случае каких-либо сомнений обращайтесь к оригинальному английскому документу. Мы приносим извинения за неудобства, которые это может вызвать.

Открыть Gazer

Открыть Gazer, коммуникационные технологии, альтернативные технологии

- название технологии: Открытое Gazer

- Link:

- Цена: бесплатно

- Популярность: NA

- Минимальные физические требования:. Пациент должен иметь возможность двигаться свободно голову

Детальное описание:

Opengazer является открытым исходным кодом, который использует обычные веб-камеры для оценки направления вашего взгляда. Затем эта информация может быть передана в другие приложения. Например, используется в сочетании с Dasher, opengazer позволяет писать с ваших глаз. Opengazer стремится быть недорогого программного обеспечения альтернативой коммерческим аппаратным трекеры глаза.

Первая версия Opengazer была разработана PiotrZieliński при поддержке Samsung и Гэтсби благотворительного фонда. Подробнее об этой версии можно найти.

исследовательский Opengazer была возрождена Emli Nel-Мари, и в настоящее время при поддержке Европейской Комиссии в рамках проекта эгидой и Гэтсби благотворительного фонда.

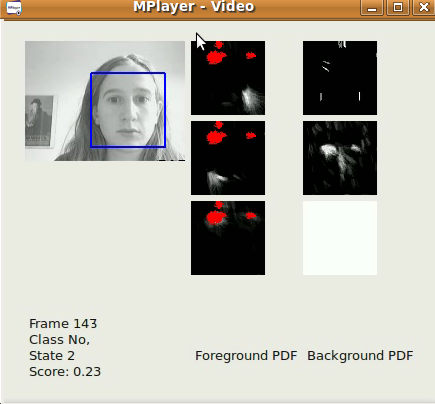

предыдущей версии Opengazer очень чувствительна к движению головы вариаций. Чтобы исправить эту проблему настоящее время мы сосредоточены на алгоритмы отслеживания движений головы для коррекции головы представляют вариации до выведения взгляд позиций. Все программное обеспечение написано на C + + и Python. Пример видео одного из наших алгоритм слежения за движениями головы можно скачать [здесь]. В Windows Видео можно просматривать с VLC Player. В Linux это лучше всего отображаются с помощью игрока Mplayer фильм.

первой версии нашего алгоритма слежения за движениями головы является элементарным, основанным на Viola-Jones лицом детектор, который определяет местонахождение крупнейшего лица в видеопотоке (захваченное из файла / камеры) как можно быстрее, на раме за кадром основе. XY-координаты из слежения может уже быть использованы для ввода с Dasher. Это можно сделать в режиме 1D (например, от отслеживания только Y-координаты), либо в режиме 2D. Хотя гораздо лучших результатов можно ожидать после выхода нашего головы представляют программное обеспечение, это программное обеспечение уже полезно для быстрой локализации лица. Наш алгоритм применяется простой авторегрессионными ФНЧ на XY-координат и масштаба от полученных результатов от Viola-Jones лицом детектора, а также ограничивает область интереса от кадра к кадру. Обнаружение параметры были определены в соответствии с нашим конкретным приложением (т.е. одного пользователя, работающего на его / ее настольный ПК / ноутбук). Алгоритм лучше всего работает на 320x240 изображений, с частотой кадров 30 кадров в секунду, и разумных условиях освещения.

подпроект Opengazer включает в себя автоматическое определение лица жесты для управления коммутатором на основе программы. Эта программа имеет короткую фазу обучения (до 30 секунд) для каждого жеста, после чего жестом определяется автоматически. Многие пациенты (например, у больных с церебральным параличом) имеют непроизвольные движения головой, что можно ввести ложных срабатываний при детектировании. Поэтому мы также тренируют модели фона иметь дело с непроизвольным движениям. Все программное обеспечение написано на C + + и Python и будет доступен для скачивания в ближайшее время. Пример видео нашего алгоритм включает жест можно скачать [здесь]. В Windows Видео можно просматривать с VLC Player. В Linux это лучше всего отображаются с помощью игрока Mplayer фильм. Обратите внимание, что это видео звук. Три жесты были обучены генерировать три возможных событий переключатель: левая улыбка, улыбка правом, и вверх брови все движения соответствуют переключения событий. Модель фона, в данном случае, обнаруживает мигает, внезапные изменения в освещении и большие движений головы. Первый официальный релиз будет в конце июня 2012 года.

Первая версия Opengazer имеет следующую процедуру:

Функция выбора точки:

Во время запуска пользователь должен выбрать функцию точек на лице с помощью мыши. Эти точки отслеживаются в последующих шагов алгоритма. Первые две точки соответствуют углам глаз, которые также используются в последующих шагах, чтобы извлечь глаз изображений. Пользователь должен держать его / ее голову совершенно неподвижно в течение всей процедуры. В этот момент пользователь должен предпочтительно сохранить все выбранные точки функции.

калибровке системы:

На этом этапе несколько красных точек отображаются на различных должностях на экране. Изображения глаза извлекают во время отображения каждой точки. Глаза изображений и их соответствующие позиции точки используются для обучения гауссовского процесса, которая представляет соответствие между изображением глаз и положение на экране. Обратите внимание, что изменения в позе головы часто требует от системы быть откалиброван.

Наблюдают:

После все точки калибровки обрабатываются гауссовского процесса дает интеллектуального распределения, так что ожидается точка глаза фокус на дисплее монитора можно оценить дано новое изображение глаза. Если пользователь загружает его / ее особенность выбранных точках, лицо Viola Jones детектора используется один раз, чтобы определить области, где поиск характерных точек не ожидается. Впоследствии, оптический поток используется для отслеживания каждой функции точки. Глаз изображения выделяют (с помощью первых двух выбранных точек углу, как ссылки), и взгляд предсказывается с использованием извлеченной глаз изображений и обученный гауссовского процесса.